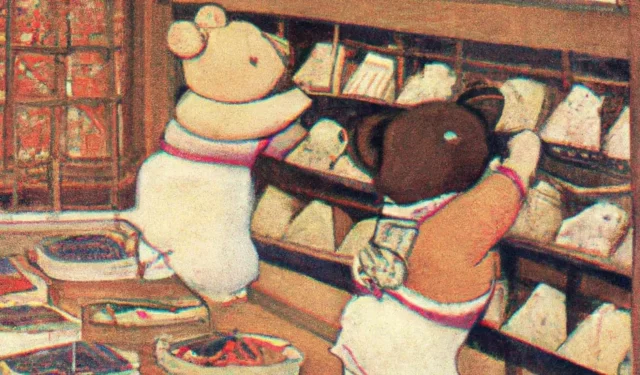

OpenAI DALL-E 2 kan gengive billeder af alt, hvad du kan forestille dig

OpenAI DALL-E 2 kunstig intelligens skaber tegneseriebilleder baseret på en tekstbeskrivelse fra din fantasi.

I januar 2021 afslørede OpenAI-konsortiet, grundlagt af Elon Musk og finansieret af Microsoft, sit hidtil mest ambitiøse projekt, DALL-E machine learning-systemet. Denne geniale multimodale kunstige intelligens var i stand til at generere billeder i tegneseriestil udelukkende baseret på brugerspecificerede søgeord. For nylig introducerede konsortiet en ny version af DALL-E med højere opløsning og lavere latenstid end den forrige.

Kunstig intelligens OpenAI DALL-E 2 skaber tegneseriebilleder

Den første version af DALL-E (forkortelse for Dalie og Wall-E) kunne generere billeder og kombinere flere billeder til en collage, foreslå forskellige vinkler og endda gætte en række billedelementer – såsom skyggeeffekter – ud fra en simpel skriftlig beskrivelse .

“I modsætning til en 3D-renderer, hvis input skal specificeres utvetydigt ned til mindste detalje, kan DALL-E ofte ‘udfylde hullerne’, når titlen antyder, at billedet indeholder visse detaljer, der ikke er eksplicit angivet,” forklarede teamet. Åbn AI i 2021.

DALL-E var aldrig beregnet til at være et kommercielt produkt, så dets muligheder var begrænsede, da OpenAI-teamet kun betragtede det som et forskningsværktøj. Det var også nødvendigt at undgå den situation, som Microsoft havde med sin Tay-chatbot, og at systemet ikke kunne generere falsk information. For denne anden version forbliver målene de samme, og der er tilføjet et vandmærke til billedet for tydeligt at indikere, at det er skabt af kunstig intelligens. Derudover forbyder systemet nu brugere at lave billeder med egennavne.

i henhold til en tekstbeskrivelse taget fra din fantasi

DALL-E 2, som bruger OpenAI CLIP billedgenkendelsessystemet, bruger sine billedgenereringsmuligheder. Brugere kan nu vælge og redigere specifikke områder af eksisterende billeder, tilføje eller fjerne elementer sammen med deres skygger, flette to billeder til én collage og skabe variationer af et eksisterende billede. De genererede billeder er nu 1024px kvadrater, mens de originale avatarer var 256px. CLIP blev designet til at opsummere indholdet af et billede på en måde, der kan forstås af et menneske. Konsortiet vendte processen ved at skabe et billede ud fra hans beskrivelse.

“DALL-E 1 tog vores GPT-3 tilgang til sprog og anvendte den til at skabe et billede: vi komprimerer billeder til et sæt ord og lærte at forudsige, hvad der ville ske næste gang,” forklarede forsker Prafulla Dhariwal til The Rod.

I modsætning til den første version, som alle kunne spille med på OpenAI-siden, er denne version 2 i øjeblikket kun tilgængelig for visse partnere, og de er selv begrænset i, hvad de kan. Kun få heldige får brug for det. De kan heller ikke eksportere billeder oprettet på en tredjepartsplatform, selvom OpenAI planlægger at gøre DALL-E 2s nye funktioner tilgængelige via en API i fremtiden. Hvis du stadig vil prøve systemet, kan du skrive dig på ventelisten .

Skriv et svar