OpenAI DALL-E 2 peut rendre des images de tout ce que vous pouvez imaginer

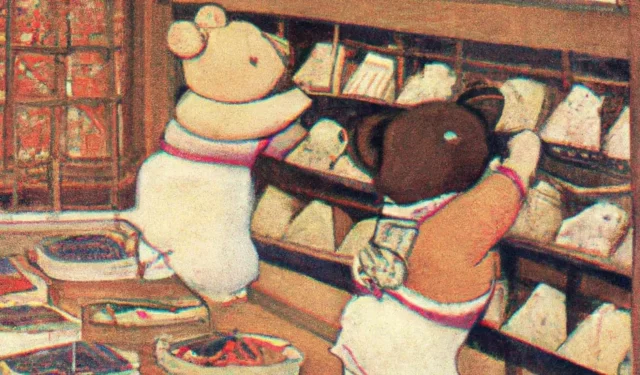

L’intelligence artificielle OpenAI DALL-E 2 crée des images de dessins animés basées sur une description textuelle issue de votre imagination.

En janvier 2021, le consortium OpenAI, fondé par Elon Musk et financé par Microsoft, dévoilait son projet le plus ambitieux à ce jour, le système d’apprentissage automatique DALL-E. Cette ingénieuse intelligence artificielle multimodale a pu générer des images de style dessin animé basées uniquement sur des mots-clés spécifiés par l’utilisateur. Plus récemment, le consortium a introduit une nouvelle version de DALL-E avec une résolution plus élevée et une latence plus faible que la précédente.

L’intelligence artificielle OpenAI DALL-E 2 crée des images de dessins animés

La première version de DALL-E (abréviation de Dalie et Wall-E) pouvait générer des images et combiner plusieurs images dans un collage, suggérer différents angles et même deviner un certain nombre d’éléments d’image – tels que des effets d’ombre – à partir d’une simple description écrite. .

« Contrairement à un moteur de rendu 3D, dont l’entrée doit être spécifiée sans ambiguïté jusque dans les moindres détails, DALL-E peut souvent » combler les lacunes « lorsque le titre implique que l’image contient certains détails non explicitement indiqués », a expliqué l’équipe. Ouvrir l’IA en 2021.

DALL-E n’a jamais été destiné à être un produit commercial, ses capacités étaient donc limitées car l’équipe OpenAI ne le considérait que comme un outil de recherche. Il fallait aussi éviter la situation que Microsoft avait avec son chatbot Tay et que le système ne pouvait pas générer de fausses informations. Pour cette deuxième version, les objectifs restent les mêmes, et un filigrane a été ajouté à l’image pour indiquer clairement qu’elle a été créée par l’intelligence artificielle. De plus, le système interdit désormais aux utilisateurs de créer des images avec des noms propres.

selon une description textuelle tirée de votre imagination

DALL-E 2, qui utilise le système de reconnaissance d’images OpenAI CLIP, utilise ses capacités de génération d’images. Les utilisateurs peuvent désormais sélectionner et modifier des zones spécifiques d’images existantes, ajouter ou supprimer des éléments avec leurs ombres, fusionner deux images en un seul collage et créer des variations d’une image existante. Les images générées sont maintenant des carrés de 1024 pixels, alors que les avatars d’origine étaient de 256 pixels. CLIP a été conçu pour résumer le contenu d’une image d’une manière compréhensible par un humain. Le consortium a inversé le processus en créant une image à partir de sa description.

« DALL-E 1 a pris notre approche GPT-3 du langage et l’a appliquée pour créer une image : nous compressons les images en un ensemble de mots et avons appris à prédire ce qui se passerait ensuite », a expliqué la chercheuse Prafulla Dhariwal à The Rod.

Contrairement à la première version, avec laquelle tout le monde pouvait jouer sur le site d’OpenAI, cette version 2 n’est actuellement disponible que pour certains partenaires, et eux-mêmes sont limités dans ce qu’ils peuvent faire. Seuls quelques chanceux peuvent l’utiliser. Ils ne peuvent pas non plus exporter d’images créées sur une plate-forme tierce, bien qu’OpenAI prévoit de rendre les nouvelles fonctionnalités de DALL-E 2 disponibles via une API à l’avenir. Si vous souhaitez toujours essayer le système, vous pouvez vous inscrire sur la liste d’attente .

Laisser un commentaire