Apple은 문 감지, 실시간 자막과 같은 새로운 iPhone 기능에 대해 이야기합니다.

세계 접근성 인식의 날은 목요일이므로 이번 주 Apple은 이번 주 뉴스 블로그를 통해 iPhone, Apple Watch, iPad 및 Mac을 위한 몇 가지 새로운 주요 접근성 기능을 발표했습니다.

가장 널리 사용되는 것 중 하나는 아마도 iPhone, Mac 및 iPad에 제공되는 라이브 캡션일 것입니다. 이 기능은 사용자가 “전화를 사용 중인지 FaceTime을 사용 중인지, 화상 회의 또는 소셜 네트워킹 앱을 사용하는지, 멀티미디어 콘텐츠를 스트리밍하는지 여부에 관계없이 전화의 모든 오디오 소스에서 나오는 음성에 대해 AI 제어 실시간 업데이트 캡션을 표시합니다. 옆에 있는 사람과 이야기를 나누는 것”이라고 말했다.

도어 감지 기능도 있습니다. 안타깝게도 LiDAR 센서가 있는 iPhone 및 iPad(예: iPhone 12 Pro, iPhone 13 Pro 또는 최신 iPad Pro 모델)에서만 작동하지만 맹인 또는 시각 장애인에게 유용하게 들립니다. 기계 학습과 결합된 iPhone의 카메라와 증강 현실 센서를 사용하여 문을 식별하고 문이 어디에 있는지, 문이 열려 있는지 닫혀 있는지, 어떻게 열 수 있는지, 문에 어떤 글이나 표시가 있는지 사용자에게 소리로 알려줍니다.

문 감지는 iOS 및 iPadOS에서 맹인 또는 시각 장애가 있는 사용자를 위해 설계된 새로운 “감지 모드”에서 사람 감지와 이미지 설명을 결합합니다. 그러나 Apple 블로그 게시물에는 이 기능이 언제 출시될지는 나와 있지 않습니다.

애플이 말하는 다른 접근성 기능으로는 20개의 새로운 보이스 오버 언어, 애플 워치의 새로운 손 제스처, 게이머가 자신의 게임 컨트롤러를 끄지 않고 다른 게임 컨트롤러를 사용하는 “친구”의 도움을 받을 수 있는 기능이 있습니다. 또한 장애인을 위한 접근성, 오디오 인식 설정, iPhone의 Apple Watch 화면 미러링을 개선하도록 설계된 새로운 Siri 및 Apple Books 설정이 있어 Watch 사용자는 iPhone에서 사용할 수 있지만 Watch에서는 사용할 수 없는 많은 특수 기능에 액세스할 수 있습니다.

기술 애호가들은 종종 스마트폰(및 일반적으로 개인 기술)이 흥미진진한 새로운 발전 없이 정체된 것을 한탄합니다. 그러나 그것은 많은 장애를 가진 사람들에게 진실에서 멀어질 수 없습니다. Google, Apple 및 수많은 연구원과 신생 기업은 강력하고 새로운 접근성 기능을 모바일 장치에 제공하는 데 상당한 진전을 이루었습니다.

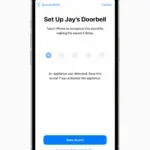

Apple 의 나열된 이미지

답글 남기기