OpenAI DALL-E 2 kan afbeeldingen weergeven van alles wat u maar kunt bedenken

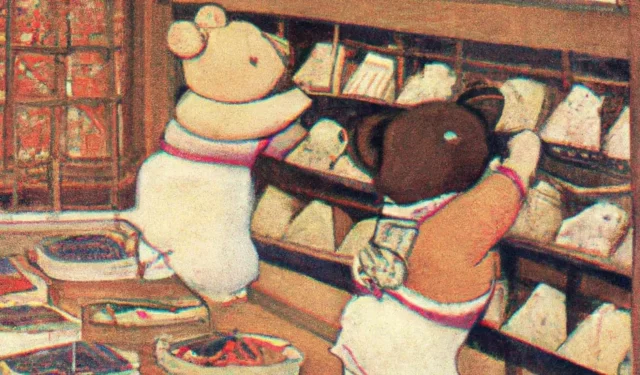

De kunstmatige intelligentie van OpenAI DALL-E 2 creëert cartoonafbeeldingen op basis van een tekstbeschrijving vanuit uw verbeelding.

In januari 2021 onthulde het OpenAI-consortium, opgericht door Elon Musk en gefinancierd door Microsoft, zijn meest ambitieuze project tot nu toe, het DALL-E machine learning-systeem. Deze ingenieuze multimodale kunstmatige intelligentie was in staat om cartoonachtige afbeeldingen te genereren op basis van door de gebruiker opgegeven trefwoorden. Meer recent heeft het consortium een nieuwe versie van DALL-E geïntroduceerd met een hogere resolutie en lagere latentie dan de vorige.

Kunstmatige intelligentie OpenAI DALL-E 2 maakt cartoonafbeeldingen

De eerste versie van DALL-E (afkorting van Dalie en Wall-E) kon afbeeldingen genereren en meerdere afbeeldingen combineren tot een collage, verschillende hoeken suggereren en zelfs een aantal afbeeldingselementen – zoals schaduweffecten – raden op basis van een eenvoudige geschreven beschrijving .

“In tegenstelling tot een 3D-renderer, waarvan de invoer ondubbelzinnig moet worden gespecificeerd tot in het kleinste detail, kan DALL-E vaak ‘de hiaten opvullen’ wanneer de titel impliceert dat de afbeelding bepaalde details bevat die niet expliciet vermeld zijn”, legt het team uit. AI openen in 2021.

DALL-E was nooit bedoeld als een commercieel product, dus de mogelijkheden waren beperkt, aangezien het OpenAI-team het alleen als een onderzoekstool beschouwde. Het was ook nodig om de situatie te vermijden die Microsoft had met zijn Tay-chatbot en dat het systeem geen valse informatie kon genereren. Voor deze tweede versie blijven de doelen hetzelfde en is er een watermerk aan de afbeelding toegevoegd om duidelijk aan te geven dat deze is gemaakt door kunstmatige intelligentie. Bovendien verbiedt het systeem gebruikers nu om afbeeldingen met eigennamen te maken.

volgens een tekstuele beschrijving uit uw verbeelding

DALL-E 2, dat het OpenAI CLIP-beeldherkenningssysteem gebruikt, maakt gebruik van zijn mogelijkheden voor het genereren van afbeeldingen. Gebruikers kunnen nu specifieke delen van bestaande afbeeldingen selecteren en bewerken, elementen samen met hun schaduwen toevoegen of verwijderen, twee afbeeldingen samenvoegen tot één collage en variaties maken op een bestaande afbeelding. De gegenereerde afbeeldingen zijn nu vierkanten van 1024px, terwijl de originele avatars 256px waren. CLIP is ontworpen om de inhoud van een afbeelding samen te vatten op een manier die door een mens kan worden begrepen. Het consortium keerde het proces om door een afbeelding van zijn beschrijving te maken.

“DALL-E 1 nam onze GPT-3-benadering van taal en paste deze toe om een beeld te creëren: we comprimeerden beelden tot een reeks woorden en leerden voorspellen wat er daarna zou gebeuren”, legt onderzoeker Prafulla Dhariwal uit aan The Rod.

In tegenstelling tot de eerste versie, waar iedereen mee kon spelen op de OpenAI-site, is deze versie 2 momenteel alleen beschikbaar voor bepaalde partners, en die zijn zelf beperkt in wat ze kunnen doen. Slechts een enkeling mag er gebruik van maken. Ze kunnen ook geen afbeeldingen exporteren die op een platform van derden zijn gemaakt, hoewel OpenAI van plan is om de nieuwe functies van DALL-E 2 in de toekomst beschikbaar te maken via een API. Als je het systeem toch wilt proberen, kun je je op de wachtlijst zetten .

Geef een reactie