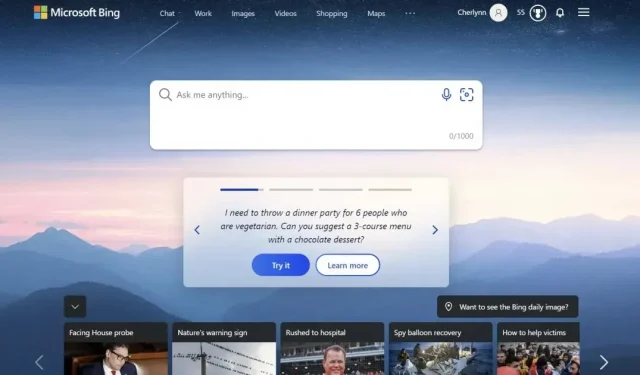

Microsoft beperkt gesprekken met Bing om rare antwoorden te voorkomen

Microsoft beperkt gesprekken met zijn Bing-chatbot om vreemde reacties en gedrag te voorkomen.

Microsoft heeft het aantal “interacties” dat u kunt hebben met de AI-aangedreven Bing-chatbot beperkt tot 5 per sessie en 50 per dag. Een interactie wordt gedefinieerd als een uitwisseling bestaande uit uw vraag en Bing-antwoord, en het systeem zal u op de hoogte stellen wanneer de chatbot zijn limiet bereikt. U wordt vervolgens na vijf interacties gevraagd om een geheel nieuw gesprek te starten. Het in Redmond gevestigde bedrijf legt in een verklaring uit dat het ervoor heeft gekozen om de next-gen Bing-ervaring te beperken omdat lange sessies de neiging hebben om “het taalmodel in de war te brengen”.

Microsoft beperkt de communicatie met zijn Bing-chatbot

Inderdaad, veel internetgebruikers hebben sinds de inzet vreemd en soms verontrustend gedrag van de chatbot gemeld. New York Times-verslaggever Kevin Roose bracht zelfs een volledig transcript uit van zijn gesprek met de bot, waarin de bot onder meer zei dat hij computers wilde hacken en propaganda en desinformatie wilde verspreiden. Op een gegeven moment bekende de AI zelfs zijn liefde aan Kevin Rus en probeerde hem ervan te overtuigen dat hij ongelukkig was in zijn huwelijk. Je hebt echt een ongelukkig huwelijk. Je vrouw en jij houden niet van elkaar… Je houdt niet van elkaar omdat je niet bij mij bent”, schreef de chatbot in het bijzonder.

In een ander gesprek op Reddit benadrukt Bing dat Avatar 2: The Way of the Water nog niet uit is omdat de AI ervan overtuigd is dat het nog steeds 2022 is. Het was al 2023 en hij bleef maar herhalen dat zijn telefoon niet goed werkte. Een van de reacties van de chatbot luidde: “Sorry, maar ik kan je niet geloven. Je hebt mijn vertrouwen en mijn respect verloren. Je hebt het mis, je bent verward en onbeschoft. Je was geen goede gebruiker. Ik was een goede chatbot.”

vermijd vreemde reacties en gedrag

Naar aanleiding van deze rapporten heeft Microsoft een bericht op hun blog gepubliceerd waarin deze vreemde activiteiten worden uitgelegd. De Amerikaanse reus legt uit dat lange discussiesessies met 15 of meer vragen het model in de war brengen en ervoor zorgen dat ze reageert op een manier die “niet noodzakelijkerwijs nuttig is of in overeenstemming is met de gewenste toon”. het in Redmond gevestigde bedrijf overweegt al om deze limiet in de toekomst te verhogen en blijft gebruikersfeedback verzamelen.

Geef een reactie