Alexa kommer att förfalska de levandes och de dödas röster i utvecklingen av funktioner

Amazon funderar på hur man får Alexas röstassistent att djupt förfalska rösten för vem som helst, död eller levande, med bara en kort inspelning. Företaget visade upp funktionen på sin re:Mars- konferens i Las Vegas på onsdagen, och använde det känslomässiga traumat från den pågående pandemin och sorgen för att skapa intresse.

Amazons Re:Mars fokuserar på artificiell intelligens, maskininlärning, robotik och andra framväxande teknologier, med tekniska experter och branschledare på scenen. Under den andra dagens keynote visade Rohit Prasad, Senior Vice President och Chief Scientist för Alexa AI på Amazon, upp en funktion som för närvarande utvecklas för Alexa.

I demonstrationen frågar ett barn Alexa: ”Kan mormor läsa färdigt The Wizard of Oz åt mig?” Alexa svarar, ”Okej”, med sin typiska kvinnliga robotröst. Men så hörs barnets mormors röst från talaren, som läser en saga av L. Frank Baum.

Du kan se en demo nedan:

Prasad sa bara att Amazon ”arbetar” med Alexa-kapaciteten och utvecklade inte vilket arbete som återstår och när eller om det kommer att vara tillgängligt.

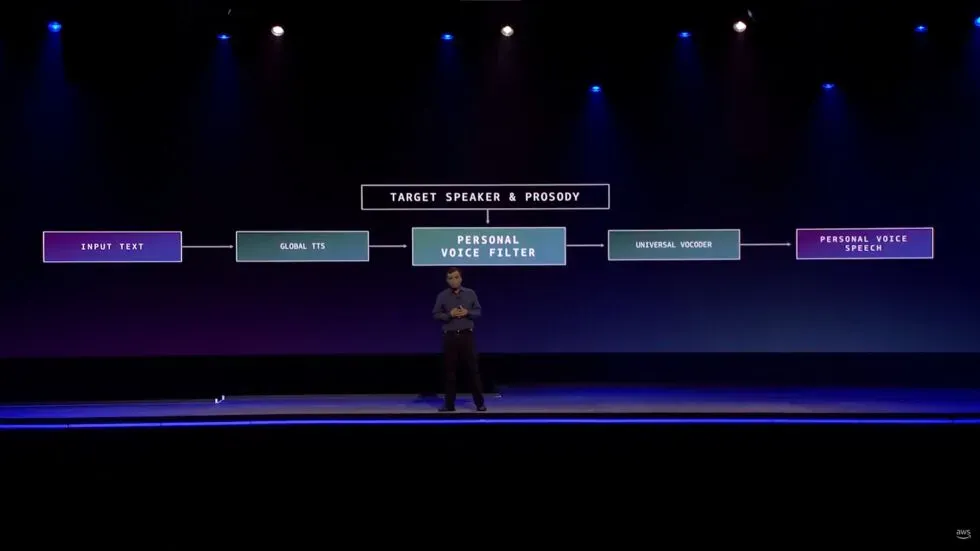

Han gav dock de minsta tekniska detaljerna.

”Det krävdes uppfinningar när vi var tvungna att lära oss att återge högkvalitativ röst på mindre än en minuts inspelning jämfört med timmars inspelning i studion,” sa han. ”Vi gjorde detta möjligt genom att formulera problemet som ett röstkonverteringsproblem snarare än ett talgenereringsproblem.”

Naturligtvis har deepfakes av alla slag i allmänhet ett blandat rykte. Vissa försök har dock gjorts att använda tekniken som ett verktyg snarare än ett fordon för läskighet.

Speciellt ljuddjupa förfalskningar, som The Verge noterar, har använts i media för att kompensera för när, säg, en podcastare förstörde en rad eller när ett projekts stjärna dog plötsligt, som hände med Anthony Bourdains Roadrunner- dokumentär .

Publikationen noterar att det till och med finns fall där personer använder AI för att skapa chatbotar som kommunicerar som om de vore förlorade nära och kära.

Alexa kommer inte ens att vara den första konsumentprodukten som använder deepfake-ljud för att ersätta en familjemedlem som inte kan vara närvarande personligen. Smart högtalare Takara Tomy , som Gi z modo påpekar, använder artificiell intelligens för att läsa godnattsagor för barn med en förälders röst. Föräldrar rapporteras ladda upp sina röster genom att läsa manuset i cirka 15 minuter, så att säga. Även om detta skiljer sig markant från Amazons demo genom att produktägaren väljer att tillhandahålla sin egen sång snarare än produkten med rösten från någon som förmodligen inte kan ge sin tillåtelse.

Bortsett från oro för att deepfakes används för bedrägerier, rån och andra skändliga aktiviteter, finns det redan några oroande saker om hur Amazon bygger den här funktionen, som inte ens har ett releasedatum än.

Innan han visade demon pratade Prasad om hur Alexa ger användarna ett ”kamratskapsförhållande”.

”I den här kamratskapsrollen är de mänskliga egenskaperna empati och påverkan nyckeln till att bygga förtroende”, sa VD:n. ”Dessa egenskaper har blivit ännu viktigare under den pågående pandemin, när många av oss har förlorat någon vi älskar. Även om AI inte kan eliminera denna smärta av förlust, kan den definitivt utöka deras minne.”

Prasad tillade att funktionen ”ger en varaktig personlig relation.”

Det är sant att otaliga människor på allvar söker mänsklig ”empati och affekt” som svar på den känslomässiga stress som orsakas av covid-19-pandemin. Amazons röstassistent för artificiell intelligens klarar dock inte uppgiften att möta dessa mänskliga behov. Alexa kan inte heller tillhandahålla ”långsiktiga personliga relationer” med människor som inte längre är med oss.

Det är inte svårt att tro att det finns goda avsikter bakom denna utvecklande funktion och att höra rösten från personen du saknar kan vara en stor tröst. Teoretiskt sett skulle vi till och med kunna ha kul med en sådan funktion. Att få Alexa att få en vän att låta som om de sa något dumt är ofarligt. Och, som vi sa ovan, finns det andra företag som använder deepfake-teknik på ett sätt som liknar vad Amazon visade.

Men att presentera Alexas utvecklande förmåga som ett sätt att återknyta kontakten med avlidna familjemedlemmar är ett gigantiskt, orealistiskt och problematiskt steg. Samtidigt verkar det vara meningslöst att röra vid hjärtats strängar, vilket orsakar sorg och ensamhet i samband med pandemin. Det finns platser som Amazon inte hör hemma, och sorgrådgivning är en av dem.

Lämna ett svar